অপরাধমূলক ব্যবহারের ঝুঁকিতে ওপেন–সোর্স এআই মডেল : গবেষকদের সতর্কতা

ওপেন–সোর্স কৃত্রিম বুদ্ধিমত্তা (AI) মডেলগুলো ক্রমেই সাইবার অপরাধীদের জন্য ঝুঁকিপূর্ণ হাতিয়ারে পরিণত হচ্ছে বলে সতর্ক করেছেন গবেষকরা।

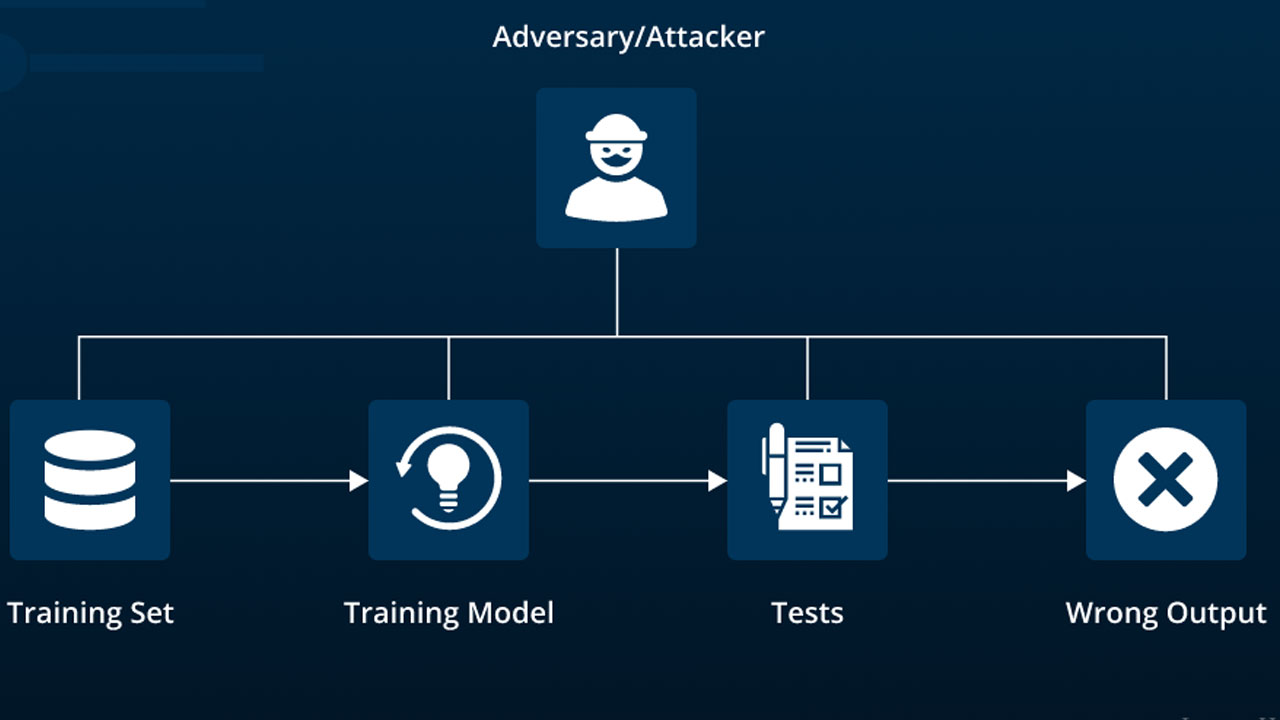

সাইবার নিরাপত্তা প্রতিষ্ঠান SentinelOne ও Censys–এর যৌথ গবেষণায় দেখা গেছে, খোলা পরিবেশে চালানো বড় ভাষা মডেল (LLM) সহজেই হ্যাকারদের নিয়ন্ত্রণে চলে যেতে পারে। এতে স্প্যাম, ফিশিং, ভুয়া তথ্য ছড়ানোসহ নানা অপরাধমূলক কাজে এসব মডেল ব্যবহার করা সম্ভব হচ্ছে।

গবেষণাটি ২৯৩ দিনের পর্যবেক্ষণের ওপর ভিত্তি করে তৈরি এবং একচেটিয়াভাবে রয়টার্সের সঙ্গে শেয়ার করা হয়েছে।

গবেষকদের মতে, ইন্টারনেটে উন্মুক্ত থাকা বহু ওপেন–সোর্স LLM–এ নিরাপত্তা ‘গার্ডরেল’ সরিয়ে ফেলা হয়েছে। ফলে এসব মডেল দিয়ে

- হ্যাকিং

- ঘৃণাত্মক বক্তব্য

- সহিংস বা অশ্লীল কনটেন্ট

- ব্যক্তিগত তথ্য চুরি

- প্রতারণা ও জালিয়াতি

এমনকি কিছু ক্ষেত্রে শিশু যৌন নির্যাতন সংক্রান্ত কনটেন্ট তৈরির ঝুঁকিও দেখা গেছে।

ইন্টারনেটে চালু থাকা অনেক LLM মূলত মেটার Llama, গুগল ডিপমাইন্ডের Gemma এবং অন্যান্য জনপ্রিয় মডেলের রূপান্তরিত সংস্করণ। গবেষকরা শত শত এমন উদাহরণ পেয়েছেন, যেখানে ইচ্ছাকৃতভাবে নিরাপত্তা বিধি তুলে দেওয়া হয়েছে।

SentinelOne–এর নির্বাহী পরিচালক জুয়ান আন্দ্রেস গুয়েরেরো-সাদে বলেন, “এআই নিরাপত্তা নিয়ে আলোচনায় এই অতিরিক্ত সক্ষমতার বিষয়টি উপেক্ষিত থেকে যাচ্ছে। এটি বরফখণ্ডের চূড়ার মতো ভেতরে ঝুঁকি আরও বড়।”

গবেষণায় আরও বলা হয়, পর্যবেক্ষণ করা সার্ভারের প্রায় ৩০ শতাংশ চীনে, এবং ২০ শতাংশ যুক্তরাষ্ট্রে অবস্থিত।

গ্লোবাল সেন্টার অন এআই গভর্ন্যান্স–এর প্রধান র্যাচেল অ্যাডামস বলেন, ওপেন মডেল প্রকাশের পর দায় শুধু ব্যবহারকারীর নয়, নির্মাতাদেরও। সম্ভাব্য ঝুঁকি আগাম চিহ্নিত করা এবং প্রতিরোধমূলক নির্দেশনা দেওয়া তাদের দায়িত্ব।

মেটা এ বিষয়ে সরাসরি মন্তব্য না করলেও তাদের Llama Protection Tools ও Responsible Use Guide–এর কথা উল্লেখ করেছে।

মাইক্রোসফট জানিয়েছে, ওপেন–সোর্স এআই গুরুত্বপূর্ণ হলেও যথাযথ সুরক্ষা ছাড়া এগুলো অপব্যবহারের ঝুঁকিতে পড়ে। এজন্য তারা মুক্তির আগেই ঝুঁকি মূল্যায়ন করে থাকে।

গবেষকদের মতে, দায়িত্বশীল ওপেন–সোর্স এআই উন্নয়নের জন্য নির্মাতা, ব্যবহারকারী ও নিরাপত্তা বিশেষজ্ঞদের যৌথ উদ্যোগ জরুরি।